Wie XR unsere Realität bis 2041 verändert

Träumen mit offenen Augen

In Zukunft werden durch XR - die Verbindung von virtueller, erweiterter und gemischter Realität – die Grenzen zwischen dem Virtuellen und Realen verschwimmen. Unsere Gastautoren beschreiben, was das für den Einzelnen und die Gesellschaft bedeutet. Der Text basiert auf Auszügen aus dem Buch „KI 2041“ (Campus Verlag).

XR bedeutet viel mehr als bloß eine Erweiterung auf einen größeren Bildschirm. In den Worten von Dr. Brennan Spiegel ist XR „wie Träumen mit offenen Augen“. Diese Technologien erzeugen eine intensive Erfahrung, die als „Präsenz“ bezeichnet wird. Virtuelle Szenen, Objekte und Figuren sind lebensecht und magisch. Die Technologie versetzt einen in eine immersive Erfahrung, die sich wie eine parallele Wirklichkeit anfühlt. In den nächsten 20 Jahren wird XR die Bereiche Unterhaltung, Ausbildung, Einzelhandel, Gesundheitswesen, Sport und Reisen revolutionieren.

Eine immersive Erfahrung sollte so beschaffen sein, dass die Nutzer_in die gleichen Sinnesempfindungen hat, die er oder sie in einer realen Umgebung haben würde, und nicht zwischen real und künstlich unterscheiden kann. Damit eine solche Sinneserfahrung realistisch ist, müssen wir unseren schärfsten Sinn, unser Sehvermögen, austricksen.

Abgesehen von XR-Brillen dürften XR-Kontaktlinsen die erste XR-Technologie sein, die den Meilenstein der Massenakzeptanz erreicht. Mehrere Start-ups arbeiten bereits an der Entwicklung von XR-Kontaktlinsen. Ihre Prototypen zeigen, dass Displays und Sensoren in Kontaktlinsen eingebettet und Texte und Bilder auf diese Weise sichtbar gemacht werden können. Diese Kontaktlinsen erfordern nach wie vor einen externen Hauptprozessor zur Datenverarbeitung, die auf einem Mobiltelefon erfolgen kann. Bis zum Jahr 2041 erwarten wir, dass die „Unsichtbarkeit“ von Kontaktlinsen den Markt dazu veranlassen wird, das Produkt zu akzeptieren, und dass Herausforderungen wie Kosten, Datenschutz und Regulierung gemeistert werden können.

So wie die visuelle Eingabe durch Brillen und Kontaktlinsen erfolgt, kann die Toneingabe durch Ohrhörer erfolgen, die mit jedem Jahr besser geworden sind. Bis 2030 sollten gute Ohrhörer durch knochenleitende, omni-binaurale immersive Ton- und andere Technologien so stark miniaturisiert sein, dass sie fast unsichtbar sind und vielleicht bequem den ganzen Tag getragen werden können.

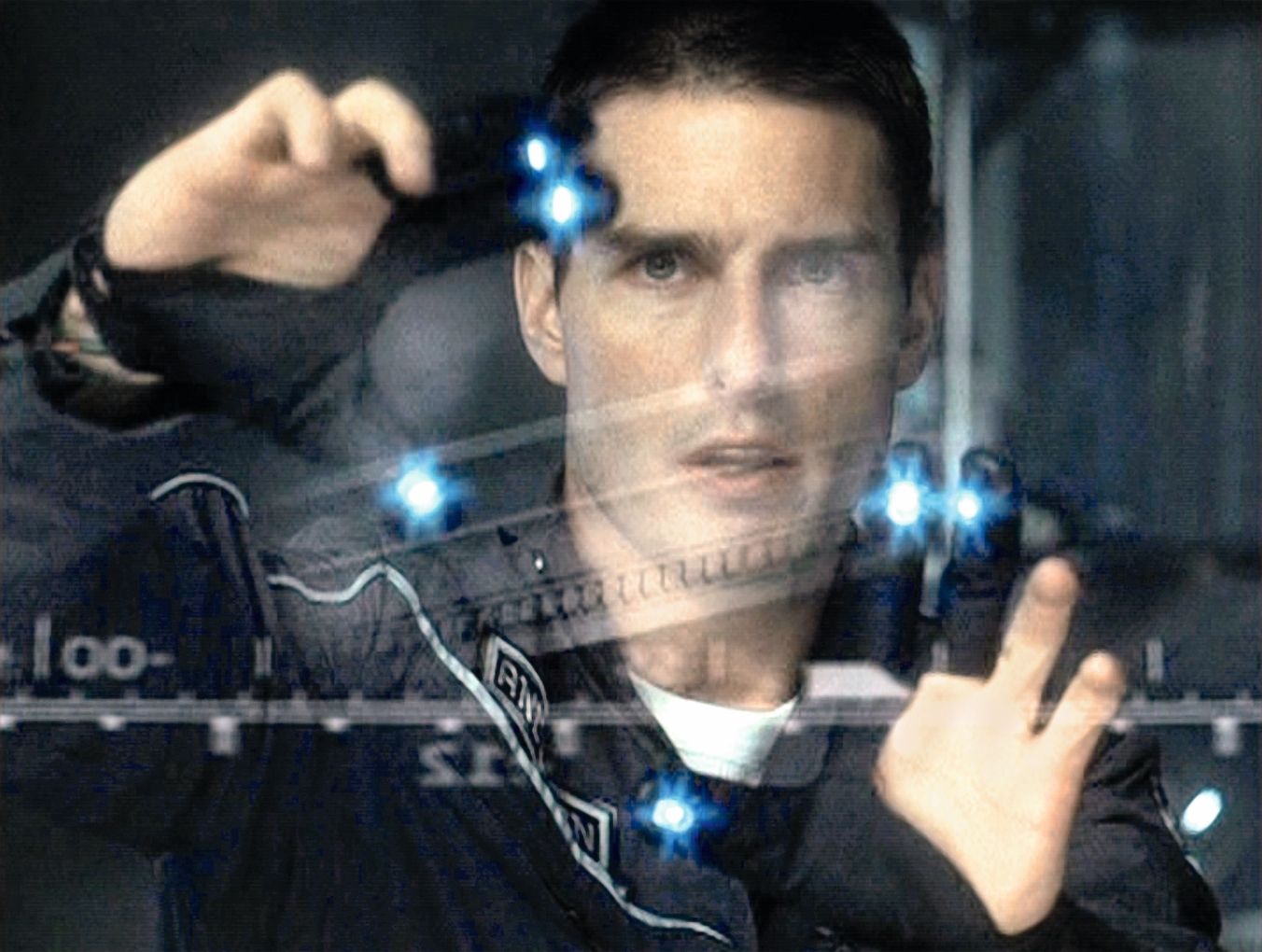

Diese Kombination dürfte sich zu einem „unsichtbaren Smartstream“ (dem Smartphone des Jahres 2041) weiterentwickeln lassen. Wenn man seinen Smartstream aktiviert, legt sich die optische Anzeige, möglicherweise halbtransparent, über das Sehfeld. Die Smartstream-Inhalte und Apps werden sich wahrscheinlich mit Gesten steuern lassen, wie es die von Tom Cruise gespielte Figur in dem Film Minority Report tut. Nutzer hören die Tonaufnahmen im Smartstream über „unsichtbare Earsets“, und sie steuern den Smartstream per Stimme, Gesten und „in die Luft“ tippenden Fingern. Dieser allgegenwärtige XR-Smartstream vermag mehr als ein Smartstream (oder Handy) mit Bildschirm. Er kann uns an den Namen einer Bekanntschaft erinnern, der wir zufällig begegnet sind, uns benachrichtigen, wenn ein Geschäft in der Nähe den Artikel führt, den wir kaufen wollen, bei Auslandsreisen Übersetzungsdienste leisten und uns Fluchtwege bei Naturkatastrophen aufzeigen. Über die gewöhnlichen „sechs Sinne“ hinaus kann unser Körper Sinnesempfindungen wie Wind und eine Umarmung, aber auch Wärme, Kälte, Vibration und Schmerzen „fühlen“. Haptische Handschuhe werden es Nutzer_innen ermöglichen, Objekte virtuell aufzuheben und zu betasten. Und somatosensorische (manchmal auch „haptisch“ genannte) Anzüge können einem das Gefühl von Kälte oder Wärme beziehungsweise Faustschläge oder eine streichelnde Hand spüren lassen.

Filmvisionen: In Science-Fiction-Klassikern wie „Minority Report“ (oben links) und der Netflix-Serie „Black Mirror“ (rechts) können die Helden in virtuelle Welten eintauchen. In Zukunft könnte das dank XR für jedermann möglich sein.

Die bisherige Analyse bezieht sich auf Geräte, die unsere Wahrnehmung stimulieren, aber wie stellen wir Inputdaten für XR bereit oder steuern diese? Heute besteht das Eingabegerät für XR aus einer in der Regel von Hand geführten Steuereinheit, ähnlich dem Xbox Controller, allerdings für gewöhnlich mit einhändiger Steuerung. Ihre Handhabung lässt sich leicht erlernen, aber sie fühlt sich unnatürlich an, je immersiver und lebensechter die Erfahrung wird. In Zukunft sollte der Input idealerweise ganz natürlich sein. Augenverfolgung, Bewegungsverfolgung, Gestenerkennung und Sprachverstehen werden miteinander verflochten und zu primären Inputs.

Ein Haupthindernis für die Realisierung dieser Erfahrungen ist die Erstellung von Inhalten. Content-Creation in einer XR-Umgebung ist vergleichbar mit der Entwicklung eines komplexen 3D-Spiels. Sie muss alle Kombinationen von Nutzerentscheidungen umfassen, die Physik realer und virtueller Objekte modellieren, die Effekte von Licht und Wetter simulieren und lebensähnliche Renderings vollbringen. Dieses Niveau an Komplexität ist viel höher als das, was notwendig ist, um Videospiele herzustellen und Apps zu entwickeln.

„Eine immersive Erfahrung sollte so beschaffen sein, dass die Nutzer_in die gleichen Sinnesempfindungen hat, die er oder sie in einer realen Umgebung haben würde, und nicht zwischen real und künstlich unterscheiden kann.“

Die Autoren:

Kai-Fu Lee

CEO der Risikokapitalgesellschaft Sinovation Ventures und Co-Vorsitzender des Artificial Intelligence Council beim Weltwirtschaftsforum

Qiufan Chen

Preisgekrönter Autor, Übersetzer, kreativer Produzent, Kurator und Präsident der World Chinese Science Fiction Association

Wenn wir technische Hilfsmittel wie Brillen oder Kontaktlinsen den ganzen Tag übertragen, erfassen wir jeden Tag unsere Umgebung. Einerseits ist es wunderbar, diesen „unbegrenzten Erinnerungsspeicher“ zu haben. Wenn ein Kunde eine eingegangene Verpflichtung nicht einhalten will, können wir das Video recherchieren, das sein Versprechen dokumentiert. Aber wollen wir wirklich, dass jedes Wort, das wir sagen, gespeichert wird? Was ist, wenn diese Daten in die falschen Hände geraten? Oder wenn sie von einer Anwendung genutzt werden, der wir vertrauen, die aber einen unbekannten externen Effekt hat?

Unter dem Strich heißt das, dass wir im Jahr 2041 im Berufsleben und in unserer Freizeit umfassend virtuelle Technologien nutzen werden. Wir sollten uns darauf einstellen, dass diese Entwicklung unvermeidlich ist. Es wird gigantische XR-Innovationssprünge geben, vermutlich zunächst in der Unterhaltungsindustrie. Aber über kurz oder lang wird XR in sämtlichen Branchen Einzug halten. So wie KI ihre „Intelligenz“ aus Daten gewinnt, so wird XR noch größere und höherwertigere Datenmengen von Menschen erheben – Daten, die von unseren Augen, Ohren, Gliedmaßen und eines Tages auch aus unserem Gehirn stammen werden. Gemeinsam werden KI und XR unseren Traum vollenden, uns selbst zu verstehen und unsere Fähigkeiten zu optimieren – und dadurch auch den menschlichen Erfahrungsraum zu vergrößern.

Info

Text erstmals erschienen im Porsche Engineering Magazin, Ausgabe 1/2023.

Copyright: Alle in diesem Artikel veröffentlichten Bilder, Videos und Audio-Dateien unterliegen dem Copyright. Eine Reproduktion oder Wiedergabe des Ganzen oder von Teilen ist ohne die schriftliche Genehmigung von Porsche Engineering nicht gestattet. Bitte kontaktieren Sie uns für weitere Informationen.

Kontakt

Sie haben Fragen oder möchten weitere Informationen? Wir freuen uns über Ihre Kontaktaufnahme: info@porsche-engineering.de